Blockchain, AI e web3 per new media e network come il Rotary?

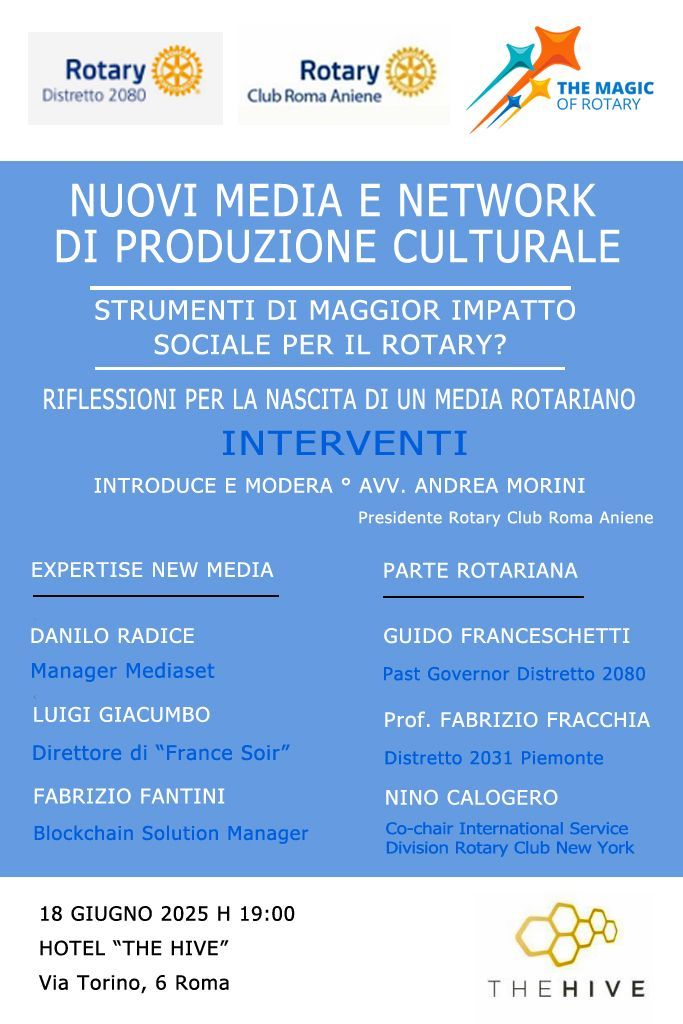

Il prossimo 18 Giugno 2025 h. 19.00 presso la Sala di cristallo del “The Hive” Hotel in Roma, Via Torino n.6 si terrà per iniziativa del Rotary Club Roma Aniene e con il patrocinio del Distretto Rotariano 2080 Lazio-Sardegna la conferenza sul tema “NUOVI MEDIA E NETWORK DI PRODUZIONE CULTURALE: STRUMENTI DI MAGGIOR IMPATTO SOCIALE PER IL ROTARY?”

L’evento si inserisce nel piano d’azione 2024-25 del Club che include anche dibattiti e tavole rotonde dedicati a tematiche inerenti le strategie di impatto del Rotary International. Key Point dell’iniziativa è quella di aprire un dibattito tra esperti di nuovi media e rotariani qualificati finalizzato a comprendere come le recenti opportunità maturate nel settore dell’entertainment e della produzione culturale dovute alle nuove tecnologie potrebbero rivelarsi un’opportunità per il RI di aumentare il proprio impatto sociale.

Dibattito che avremmo piacere di far proseguire anche presso altri Distretti del paese come asset strategico, a questo primo evento saranno presenti:

- Danilo Radice (già Manager Mediaset Tv e specialist produzione/realizzazione programmi tv)

- Luigi Giacumbo (già Direttore di “France Soir” e manager di gruppi editoriali),

- Fabrizio Fantini Blockchain Solution Manager per la parte di expertise sui nuovi media;

- Guido Franceschetti, il Past Governor Distretto 2080

- il Prof Fabrizio Fracchia (Università Bocconi) del Distretto 2031 Piemonte

- il Nino Calogero, co-chair dell’International Service division del Rotary Club di New York, questi per la parte rotariana.

Il tea mdi INNOVABILITA e EUREBO MULTIMEDIA sperimentano tecnologie abilitanti da molti anni e la maggior parte delle applicazioni dell'intelligenza artificiale integrate con smart contract presto saranno implementate nei prodotti di sicurezza di molti fornitori per proteggere singoli e organizzazioni dalle minacce informatiche. Già oggi esistono sandbox cloud potenziata dall'intelligenza artificiale che offrono il meglio della tecnologia di rilevamento, sia interna che di prodotto, per un'analisi completa on-demand in pochi minuti o secondi. L'idea di creare nuovi contenuti utilizzando modelli basati sull'intelligenza artificiale esiste da anni ed è stata utilizzata in campi specifici, come la chimica computazionale. Tuttavia, per i compiti legati alla sicurezza, era necessario un approccio diverso. Nel 2017 Google ha pubblicato un documento intitolato Attention Is All You Need, in cui ha proposto una nuova architettura per i modelli di apprendimento automatico basata sui meccanismi di attenzione. Denominata "transformer", questa architettura si è dimostrata molto efficace nell'elaborazione del linguaggio naturale e nella produzione di un'ampia varietà di contenuti comprensibili all'uomo. Dal 2023, modelli come ChatGPT, Midjourney e DALL-E, Claude, Gemini hanno catturato l'attenzione del pubblico dimostrando che con un semplice input dell'utente - un prompt di testo - i modelli basati su trasformatori possono scrivere un articolo completo, generare una foto realistica e produrre nuovi video. Naturalmente, questa è solo la punta dell'iceberg, che non ha ancora raggiunto le testate giornalistiche. La nuova classe di modello di trasformatori ha comportato un nuovo ciclo di test e confronto con i campioni dannosi. Grazie ai risultati positivi, questa tecnologia si può introdurre nei sistemi di rilevamento cloud multilivello e nei moduli di rilevamento endpoint. Nella cybersecurity, prestazioni costanti e affidabilità sono fondamentali. Se una soluzione di sicurezza basata sull'intelligenza artificiale ottiene ottimi risultati di rilevamento e pochi falsi positivi una settimana, ma non riesce a rilevare il malware o crea una marea di falsi allarmi la settimana successiva, questo non fa che aumentare il carico del team di sicurezza. La supervisione umana esperta da parte dei progettisti del modello o dei modelli principali della soluzione di sicurezza è quindi fondamentale per mantenere elevati tassi di rilevamento e bassi tassi di falsi positivi nel lungo periodo.

L'addestramento del modello prima dell'implementazione, volto a comprendere le specificità di un'organizzazione, è sempre preferibile alla creazione di una marea di falsi positivi o falsi negativi. Non credete a tutto ciò che vedete online: questa è una regola che si applica soprattutto ai contenuti creati dall'IA generativa. Molti degli attuali modelli di AI gen sono in grado di calcolare la migliore parola o il miglior pixel possibile per seguire un dato input, con l'obiettivo finale di produrre risultati simili a quelli umani e credibili. Tuttavia, ciò può talvolta portare a informazioni apparentemente plausibili ma non corrette, con riferimenti, fonti, dati, autori, dichiarazioni o URL falsificati o allucinati, il che rende necessaria una continua supervisione e verifica da parte degli esseri umani. L'allucinazione mette in discussione l'impiego dell'IA generativa in molti campi, tra cui la sicurezza informatica, dove i risultati delle analisi dei campioni basati su dati inventati potrebbero essere etichettati in modo errato. Allo stesso modo, un'interpretazione allucinata delle informazioni sulle minacce può portare a consigli, decisioni e politiche sbagliate o addirittura pericolose, compromettendo potenzialmente la sicurezza di interi ambienti. Le allucinazioni dell'IA generativa possono essere utili per casi d'uso specifici. Se l'obiettivo è generare nuovi contenuti audio, video o visivi, l'algoritmo deve avere la "libertà creativa" di produrre idee nuove o di rispondere alla richiesta in un modo che nessun essere umano potrebbe fare. L'impiego dell'IA generativa - ma anche di altri modelli - per compiti specifici può essere piuttosto macchinoso. La sfida è spesso rappresentata dal set di addestramento, che deve essere scelto e classificato con precisione per ottenere i risultati desiderati. Ci sono molti esempi di modelli che, in mancanza di una classificazione e di un sistema di protezione adeguati, sono stati fortemente distorti e hanno generato risultati erronei. Allo stesso modo, se il set di addestramento non è selezionato con cura, classificato correttamente e bilanciato, il modello di cybersecurity potrebbe diventare eccessivamente sensibile e produrre una marea di falsi positivi o concentrarsi su aspetti non importanti perdendo di vista attributi chiaramente dannosi.

Per rendere le cose più difficili, i criminali informatici cercano costantemente di rendere il loro "prodotto" invisibile o innocuo aggiungendo strati di impacchettamento, offuscamento, crittografia. Un modello di intelligenza artificiale senza strumenti aggiuntivi adeguati, senza formazione e senza la supervisione di un esperto umano non sarà in grado di gestire questi ostacoli e quindi non riuscirà a rimuovere gli strati di offuscamento per arrivare al nucleo dannoso del campione. Questo potrebbe influenzare negativamente il risultato dell'analisi dell'IA, con il risultato di ottenere informazioni di scarso valore per gli addetti alla difesa. Gli aggressori possono anche modularizzare il malware in modo che ogni modulo appaia innocuo in sé, mostrando il proprio carattere dannoso solo in combinazione con altri elementi. In questi casi, anche l'intelligenza artificiale può essere facilmente ingannata, classificando erroneamente questo tipo di file come innocui. Le macchine di oggi sono in grado di battere gli esseri umani a scacchi e stanno rapidamente diventando più abili anche in altri campi, anche nella generazione di sceneggiature originali tuttavia, la maggior parte di essi prevede regole ferree. Gli attori delle minacce, invece, non seguono le linee guida o accettano le limitazioni per poi barare, manipolare o cambiare le carte in tavola senza preavviso. Questa natura in continua evoluzione dell'ambiente delle minacce rende impossibile creare una soluzione di protezione universale in grado di contrastare tutte le minacce attuali e future, e nemmeno i più recenti modelli di intelligenza artificiale possono cambiare la situazione. Un buon esempio sono le auto a guida autonoma. Nonostante i massicci investimenti per il loro sviluppo, questi veicoli si affidano in larga misura alla segnaletica ambientale, come i segnali stradali e le luci. Un avversario potrebbe attaccare i veicoli senza conducente coprendo i segnali stradali o facendo lampeggiare i semafori a una velocità irriconoscibile per l'occhio umano. Con queste deformazioni, queste auto potrebbero prendere decisioni sbagliate e causare incidenti mortali. Sottovalutare l'utilizzo della tecnologia IA nelle mani di criminali informatici e di sofisticati attori delle minacce lascerebbe le organizzazioni e i loro difensori pericolosamente impreparati.

Minacce potenziate dall'intelligenza artificiale previste per il 2030 sono:

• Generare campagne di social engineering simili a quelle umane, compreso lo spearphishing.

• Ottimizzare il malware e adattarlo agli ambienti selezionati.

• Replicare e attuare false flag.

• Migliorare la selezione e l'individuazione dei target.

• Ricerca di nuove vulnerabilità nel software e nel firmware IoT.

• Generare nuovo malware o riscriverlo in diversi linguaggi di programmazione.

• Innescare meccanismi autodistruttivi nel malware come ultima risorsa per ostacolare le indagini e le analisi.

• Diminuire il tempo di un attacco per ridurre il tempo di reazione.

• Apprendimento collettivo delle botnet (IoT).

• Generare una grande quantità di campagne di spam, scam e phishing di alta qualità.

• Generazione di una grande quantità di disinformazione, immagini e video deepfake di alta qualità da utilizzare per truffe ed estorsioni.

• Analizzare il traffico di rete e gli input provenienti da dispositivi compromessi e il successivo utilizzo di queste informazioni per nascondere e proteggere l'infrastruttura, il codice, le operazioni e gli attori delle minacce dannose.

• Estrazione di informazioni legalmente protette, proprietarie o altrimenti sensibili note ai modelli generativi tramite prompt maligni appositamente creati.

• Potenziare le campagne di social engineering sfruttando la comunicazione simile a quella umana generata dai LLM.

La generazione di nuovi contenuti dannosi ha occupato un posto di rilievo in questo elenco. Nel 2018 erano soprattutto le traduzioni online basate su AI alimentare questo tipo di attività; oggi, armati di LLM in grado di imitare lo stile di scrittura di qualsiasi persona, gli aggressori possono progettare campagne di spam e truffa avanzate che stanno diventando sempre più difficili da identificare solo dal contenuto dei loro messaggi. Lo stesso vale per le campagne di disinformazione. Un tempo si trattava di un'attività laboriosa, svolta da schiere di troll con decine, se non centinaia, di lavoratori umani.

Con i modelli di IA generativa, riscrivere un articolo online e infarcirlo di falsità, foto truccate o video deepfake è ora più semplice e facilmente ripetibile: richiede solo una manciata di "creator" umani addestrati. Inoltre, informazioni di questo tipo potrebbero avere un'influenza molto maggiore sui social media, dove spesso le persone si limitano a scorrere i titoli e le immagini che li accompagnano. Alcune forme di IA e di apprendimento automatico potrebbero essere utilizzate per proteggere le infrastrutture dannose.

L'utilizzo di un modello di apprendimento automatico avrebbe reso molto più semplice questo compito per questi criminali. Anche lo spearphishing è destinato a registrare un aumento significativo del ritorno sull'investimento, in quanto l'alimentazione di un LLM con le e-mail e le informazioni della vittima rubate consente agli aggressori di redigere un messaggio dall'aspetto attendibile. Se un messaggio di questo tipo viene introdotto in una delle conversazioni precedenti della vittima - una tecnica nota come attacco reply-chain - le probabilità che gli aggressori raggiungano i loro obiettivi aumentano drasticamente. D'altra parte, non tutte le minacce sono così reali come le dipingono alcuni titoli dei giornali, come nel caso della scrittura di malware da zero. Sebbene siano preoccupanti, le capacità di codifica dell'IA sono ancora limitate. Gli attuali modelli generativi potrebbero essere utili per compiti circoscritti, come la riscrittura di librerie, il debug, l'ottimizzazione del codice e forse anche la stesura di una semplice funzione strettamente specificata. Tuttavia, i risultati dell'IA non sono ottimali quando si scrivono strumenti o software complessi, compresi quelli destinati a scopi dannosi. Sebbene malware di alta qualità sia già stato prodotto dall'intelligenza artificiale, si tratta solo di una delle tappe di un lungo percorso che la renderà una minaccia efficace e redditizia. Gli aggressori devono progettare una strategia di distribuzione, escogitare il modo di aggirare il rilevamento da parte degli strumenti e del personale di sicurezza, capire come monetizzare l'accesso e le informazioni rubate e talvolta anche comunicare ulteriormente con la vittima. L'intelligenza artificiale può essere utile per alcuni di questi passaggi, ma non può sostituire completamente un avversario umano intelligente, almeno non ancora.

INNOVABILITA sperimenta tecnologie abilitanti in un ecosistema dell'innovazione da oltre 10 anni con l'attuale ritmo dei progressi dell'IA, probabilmente assisteremo a significativi miglioramenti dei modelli di IA in tutte le attività creative nei prossimi anni programmando scenari fantascientifici che non si sono ancora materializzati, ma potrebbero diventare realtà nel prossimo futuro.Gli attori delle minacce potrebbero addestrare modelli generativi di intelligenza artificiale sulla base di ricerche pubblicate sulle attività di altri criminali informatici, in modo da condurre campagne spacciandosi per loro. Ciò complicherebbe ulteriormente il già difficile compito di ricondurre i cyberattacchi a gruppi specifici. L'intelligenza artificiale potrebbe individuare nella massa gli obiettivi più interessanti, che si tratti di un dipendente negligente o ingenuo con ampi privilegi di sistema o di un subappaltatore con sistemi mal protetti o mal configurati. Gli ultimi anni hanno dimostrato che le vulnerabilità zero-day sono un'attività redditizia sia per i gruppi che si dedicano all'intrusione e allo spionaggio sia per i criminali informatici in cerca di guadagni finanziari. L'addestramento di modelli basati sull'intelligenza artificiale per la ricerca di falle sconosciute e sfruttabili potrebbe aprire le porte di quasi tutti gli ambienti informatici del pianeta, soprattutto se sono presenti dispositivi Internet of Things (IoT), notoriamente poco sicuri e spesso non patchabili. L'intelligenza artificiale potrebbe aiutare gli attori delle minacce a far crescere nuove botnet, rendendole più efficaci e capaci di apprendimento collettivo. Ciò significa che potremmo vedere questi grandi organismi digitali impegnati in operazioni più ampie e sofisticate, come la ricerca di vulnerabilità o la raccolta di informazioni, invece di essere utilizzati semplicemente negli attacchi DDoS (Distributed Denial-of-Service). L'IA rappresenta una tecnologia estremamente vantaggiosa per la sicurezza informatica. Integrata nelle soluzioni di protezione, l'intelligenza artificiale può potenziare le capacità di rilevamento e risposta alle minacce, sensibilizzare gli utenti e rendere più accessibili servizi quali l'intelligence e la threat intelligence, migliorando così la protezione e la prevenzione di attacchi avanzati. Riducendo il numero di notifiche superflue e fuorvianti, consente inoltre agli esperti di cybersecurity di identificare e rispondere alle attività dannose in modo più rapido ed efficiente.

L'adozione dell'IA può ancora avere e probabilmente avrà un effetto di trasformazione in altre aree della cybersecurity, come la creazione di nuovi rilevamenti, la scansione di vulnerabilità sconosciute e l'assistenza alla corretta configurazione degli strumenti di protezione. Nonostante questi vantaggi, l'IA nelle sue molteplici forme presenta una serie di limiti e sfide. Tra questi, il requisito di set di addestramento di alta qualità, il rischio di alti tassi di falsi positivi e la necessità di aggiornamenti e di una supervisione umana esperta. Non vanno trascurati i potenziali scenari di uso improprio dell'IA da parte di soggetti malintenzionati. Gli attori delle minacce possono – e alcuni lo stanno già facendo – sfruttare questa tecnologia per generare campagne di spam e truffe convincenti, migliorare le loro attività di social engineering, eludere il rilevamento e il monitoraggio e persino eseguire il debug e ottimizzare il malware. Sebbene queste minacce siano preoccupanti

Il team di INNOVABILITA e EUREBO HUB da molti anni sono impegnati nella divulgazione del senso dell'open innovation nella co-creazione di ecosistemi di valore per l'utilizzo ecosistemico di tecnologie di confine: l'IA non è in grado di sostituire completamente un avversario umano intelligente, soprattutto nello svolgimento di compiti collaterali complessi, come concepire una catena di attacco efficace o generare codice maligno nuovo e sofisticato. Abbiamo previsto di realizzare un progetto crossmediale sulla nascita di questo movimento prendendo come personaggio riparatore il “traghettatore” Stefano Pelloni, il Robin Hood romagnolo - per sottolineare l'importanza di comprendere e sfruttare l'IA nel campo della sicurezza informatica associata alla nuova produzione di new media e del cinema AI. Allo stesso tempo, riconosciamo i limiti e i rischi potenziali dell'utilizzo di questa tecnologia senza una corretta conoscenza condivisa della materia. Sosteniamo la necessità di un approccio crossmediale equilibrato e certificato nelle fonti che combini l'IA con una supervisione umana esperta per garantire lo sviluppo di soluzioni di cybersecurity affidabili nel settore dei new media e del cinema AI.

Gli studi di Hollywood accelerano VEO 3

Veo 3 è lo strumento di Google per la produzionecinematografica generativa, stimola l'esplorazione a Hollywood, ma la proprietà creativa resta incerta. Appena un anno dopo il lancio, la tecnologia AI text-to-video di Google DeepMind, Veo, ha raggiunto la versione 3 rappresenta una svolta nella generazione automatica di contenuti cinematografici, tanto che gli studi Sony Pictures, Warner Brothers, Disney, Paramount e Universal si stanno unendo per realizzare un breve filmato AI per scoprire cosa può fare questa tecnologia. Il progetto sperimentale intitolato The Bends è prodotto dall'Entertainment Technology Center (ETC), un think tank e ente di ricerca con sede presso l'Università della California del Sud (USC), sponsorizzato da studi e aziende tecnologiche tra cui Epic Games e Google. Stiamo assistendo a un vero e proprio cambiamento di rotta nell'ambito dell'intelligenza artificiale passata dall'essere un argomento temuto a uno strumento in grado di supportare le produzini cinematografiche hollywoodiane. L'Entertainment Technology Center (ETC) dimostra come Veo 3 e altri strumenti di intelligenza artificiale vengono utilizzati per produrre il cortometraggio interamente generato dall'intelligenza artificiale The Bends

The Bends è un film di intelligenza artificiale puramente generativa che tratta di un pesce blob, scritto e diretto dalla giovane regista freelance Tiffany Lin, ed è uno dei due progetti basati sull'intelligenza artificiale finanziati da ETC. L'altro, intitolato Pathways, esplora un flusso di lavoro ibrido e indaga come si filma una performance live action e poi si usa l'intelligenza artificiale per modificare tutto sullo sfondo. Roberto Schaefer, direttore della fotografia di Neverland, candidato ai BAFTA , è consulente per The Bends con un accesso anticipato a Veo 3 oggi possono ottenere immagini coerenti da poter utilizzare in un montaggio cinematografico.

Gli studi vogliono studiare quali sono i limiti, cosa possono fare, come può funzionare, e non devono preoccuparsi del copyright perché questi non sono show realizzati per la distribuzione commerciale, ma solo per fini educativi: Veo 3 eccelle nel tradurre prompt complessi in video realistici, con una risoluzione di 1080p.

Può generare esseri umani sintetici con caratteristiche realistiche, come cinque dita per mano. I nuovi controlli della telecamera aiutano a definire movimenti precisi, tra cui rotazioni, carrelli e zoom. E a differenza di Sora, il generatore video di OpenAI, il software di Google può generare simultaneamente audio, inclusi dialoghi con una sincronizzazione labiale accurata, partendo da un singolo prompt di testo.

I prompt sono molto più accurati e non esistono vere allucinazioni né veri problemi di continuità delle immagini o dei volti. Si possono creare sequenze più strutturate da un singolo prompt fino a 8 secondi di lunghezza ma credo che si arriverà a due minuti per prompt. È come una ripresa con la Steadicam. Sono riprese lunghe che non si usano nella maggior parte degli show. La fedeltà dei personaggi simulati permette già oggi di immaginare un futuro modello di "CINEMA AI". Uno YouTuber di nome Revid ha recentemente pubblicato uno spot pubblicitario realizzato con Veo 3 per una finta azienda farmaceutica per dimostrare i nuovi modelli economici di produzione. Racconta di aver girato spot pubblicitari con budget di 500.000 dollari e 50 troupe, impiegando due mesi tra pre-produzione, riprese e post-produzione: lo stesso spot pubblicitario in alta risoluzione si può oggi realizzare con 500 dollari. In meno di 24 ore. Da solo. Con Veo 3 si passa dall'idea iniziale allo spot finale più velocemente di quanto mi ci volesse prima solo per ottenere l'approvazione dei permessi. Revid spiega che ChatGPT lo ha aiutato a fare brainstorming e a perfezionare le idee per la sceneggiatura, dopodiché ha generato 13 inquadrature diverse utilizzando solo prompt di testo. Non si tratta solo di una riduzione dei costi, ma di una trasformazione radicale del modo in cui vengono prodotti i contenuti. Stiamo assistendo alla democratizzazione della produzione video di fascia alta in tempo reale. Se si possono creare spot pubblicitari di qualità broadcast per 500 dollari al giorno, perché un'azienda dovrebbe continuare a spendere mezzo milione di dollari e aspettare mesi per ottenere lo stesso risultato?

Il cortometraggio oggi rappresenta un test, ma è sicuramente solo questione di tempo prima che i film lunghi realizzati con l'intelligenza artificiale arrivino su internet.

EUREBO HUB propone progetti di intelligenza artificiale con l'ETC per capire come utilizzarla, perché l'intelligenza artificiale è inevitabile e presto anche in Italia saranno girati comunque film con set, attori e telecamere reali, ma i direttori della fotografia dovranno familiarizzare con l'intelligenza artificiale al montaggio finale. Proprio come Roger Deakins (Non è un paese per vecchi), candidato a più premi Oscar, è stato assunto come consulente visivo per WALL-E (2008) della Pixar, Schaefer (che ha anche girato Monster's Ball, The Paperboy, Quantum of Solace, la serie Amazon The Peripheral e Geostorm) sta prestando il suo occhio esperto per contribuire a rendere le immagini e la narrazione più cinematografiche. Un film di intelligenza artificiale è fondamentalmente un film d'animazione, che abbia un aspetto fotorealistico o che sembri un cartone animato, permettono ai nuovi produttori dei new media AI di creare nuovi tipi di inquadrature, nuove forme di 'illuminazione diverse gestioni del colore. In pratica l’AI supporta i registi della nuova generazione di CINEMA AI a raccontare una storia con le immagini generate in tempo reale e modificate sullo schermo durante il set. Nei prossimi anni sarà generato un nuovo glossario dei termini per il movimento della telecamera, il tipo di obiettivo, la lunghezza focale e altre descrizioni tecniche. Tutti i diversi termini e le conoscenze che i direttori della fotografia usano comunemente sul set, li sto fornendo allo sceneggiatore e regista di The Bends, affinché li utilizzi per i suggerimenti. Un'idea è quella di addestrare l'IA a "comprendere" il vocabolario cinematografico per aiutare i registi AI a creare meglio le immagini cinematografiche piuttosto che far inventare all'AI termini folli basati sulla logica del computer. La macchina diventerà sempre più brava a comprendere luci, ombre, inquadrature e tutto il resto e prima o poi si raggiungerà una funzionalità longform completamente generata dall'AI.. C'è una scuola di pensiero secondo cui i drammi indie low budget di Ken Loach, Mike Leigh o Sean Baker rimarranno immuni all'IA. Anche se questi registi potrebbero rifuggire la tecnologia, nulla impedisce a una macchina di imitare il loro lavoro. I nuovi “storydoers” inizieranno presto a realizzare finti documentari crudi e film in stile docufilm dove la qualità visiva del software raggiungerà livelli di perfezione difficili distinguere le riprese di persone reali da quelle create da macchine generative. Il più grande ostacolo che impedisce agli studi cinematografici di utilizzare l'intelligenza artificiale per la generazione di immagini nelle produzioni commerciali sindacalizzate è il copyright. Google afferma di aver collaborato strettamente con le industrie creative per "contribuire a plasmare" i suoi modelli e ha annunciato una partnership di questo tipo con il regista Darren Aronofsky. Non estraneo alle nuove tecnologie, Aronofsky ha anche realizzato un filmato promozionale per la Las Vegas Sphere. Google rivendica "creazione responsabile e collaborazione con la comunità creativa", basandosi su SynthID, un sistema di watermarking che aiuta a identificare oltre 10 miliardi di risorse come generate dall'intelligenza artificiale. Ha appena lanciato SynthID Detector, un portale di verifica che aiuta gli utenti a identificare i contenuti watermarkat da SynthID. Sebbene ciò possa ridurre il rischio di disinformazione e attribuzione errata, non è chiaro come risolva il problema del plagio su modelli che presumibilmente hanno copiato da internet senza alcun collegamento tracciabile o ricompensa per risalire all'autore originale. L'unica azienda con un minimo di coscienza è Adobe, studi come Disney stanno sviluppando modelli di intelligenza artificiale interni basati sul proprio archivio, ma questo potrebbe essere troppo limitato: possono assumere artisti per creare un nuovo volto, un nuovo sfondo, qualcosa di nuovo per creare un intero universo utilizzando solo elementi di loro proprietà. Pinar Demirdag, co-fondatrice e CEO della piattaforma di intelligenza artificiale Cuebric ha sostenuto che innovare con l'intelligenza artificiale e preservare l'arte incentrata sull'uomo non si escludono a vicenda. Dopo l'invenzione della fotografia, la pittura non è scomparsa. Dopo l'introduzione del colore, il bianco e nero non è scomparso. È diventata una scelta. Quindi le nostre possibilità di espandere la nostra creatività saranno immensamente vaste, siamo tutti consapevoli dei pericoli della normalizzazione della mediocrità che l'intelligenza artificiale può portarci, un giorno forse premeremo un pulsante e ci verranno presentate alcune opzioni, ma in qualche modo concordiamo collettivamente su cosa sia un buon contenuto, cosa sia una buona arte.

Una delle caratteristiche distintive, e sconvenienti, dell'industria dei media e dell'intrattenimento è la sua incapacità di parlare logicamente del futuro. Tendiamo a oscillare tra la disperazione e l'esagerazione. A un certo punto, ci lamentiamo disperati perché, di fronte a così tanti cambiamenti, chissà cosa succederà? E subito dopo, esclamiamo che l'ultima tendenza o innovazione cambierà tutto. In un momento in cui ci sono davvero così tanti cambiamenti e disponiamo di una tecnologia chiamata intelligenza artificiale che tutti, non solo chi lavora nei media, sostengono cambierà tutto, come possiamo pensare al futuro in modo sensato? La risposta potrebbe essere quella di identificare alcune delle cose di cui possiamo sentirci sicuri e poi vedere quali domande derivano da quelle affermazioni. Non fornirà una mappa per il futuro, ma potrebbe impedirci di sprecare tempo e denaro in vicoli ciechi. Se riusciamo a concordare su alcuni aspetti noti, allora forse potremo concordare anche sulle incognite che rendono le incertezze future più prevedibili. Il significato del contenuto verrà ridefinito Ricordate quando abbiamo smesso di parlare di cinema e TV e abbiamo iniziato a parlare di contenuti? È iniziato circa 20 anni fa, quando il digitale è diventato realtà, e si è trattato di un tentativo – con grande irritazione di chi produceva cinema e TV – di essere più inclusivi su cosa costituisse intrattenimento e informazione audiovisiva. I professionisti del settore continuano a tracciare il passato e il futuro nei titoli di film e spettacoli. Ora questi stessi professionisti esprimono un'ansiosa fascinazione per qualcosa chiamata "economia dei creatori": un misterioso altro mondo in cui persone senza un titolo professionale realizzano video che i consumatori sembrano voler guardare. L'economia dei creatori prevede un continuum narrativo che va da un film campione di incassi a un TikTok con un media complesso, densamente popolato, popolare e, soprattutto, professionalizzato che tutto deve essere incluso nella parola "contenuto". Ciò che non sappiamo è quale attrazione gravitazionale si rivelerà più potente: i creatori attratti dai media consolidati; o i media consolidati che costruiscono una presenza negli spazi creativi. Non sappiamo come evolveranno i modelli commerciali per le diverse tipologie di contenuti e come questo avrà un impatto sul mercato dei media, dato che sappiamo che sia il denaro che gli spettatori sono limitati. Non conosciamo l'equilibrio tra l'importanza dello studio e quella della piattaforma. E, naturalmente, non sappiamo come l'uso di strumenti di intelligenza artificiale da parte dei creatori emergenti influenzerà la forma dei contenuti. Diversi tipi di creatori, che producono per diverse piattaforme con diversi modelli commerciali, si riforniranno di strumenti e servizi provenienti da fonti diverse. Ci saranno strumenti di nicchia e specializzati. Ci saranno strumenti generici e di massa. Ciò che non sappiamo è che effetto avrà tutto questo sui mercati dei fornitori di film e TV, video consumer, audiovisivi professionali e IT, attualmente notevolmente distinti. Convergeranno o si frammenteranno ulteriormente? La natura di nicchia di ogni tipologia di contenuto limiterà investimenti e innovazione, mentre strumenti generici saranno sempre più utilizzati e adattati? Potrebbe verificarsi una disintermediazione della catena di fornitura dei media, con la media factory trasformata in una commodity dalle aziende tecnologiche globali? Con la diversificazione e la frammentazione dei contenuti, i consumatori sceglieranno servizi di aggregazione che semplifichino la ricerca, la scoperta, la raccomandazione e il pagamento. Una conseguenza inevitabile di ciò sarà che, sebbene il mercato dei fornitori di contenuti rimanga diversificato, le piattaforme e i servizi si consolideranno. Ciò che non sappiamo è quali forme di aggregazione prevarranno, almeno inizialmente. Sarà il bundling, l'aggregazione di singole app o l'aggregazione all'ingrosso di contenuti? Attualmente, l'aggregatore di contenuti più autentico e significativo è YouTube. Emergeranno dei rivali? Quante piattaforme gestite dai proprietari riusciranno a sopravvivere? Le emittenti consolidate distribuiranno sempre più tramite piattaforme di aggregazione? La spesa pubblicitaria seguirà l'andamento di specifiche piattaforme e tipologie di contenuti. La concorrenze per ottenere questi ricavi in un mercato pubblicitario vincolato influenzerà sempre di più le decisioni di distribuzione tra le organizzazioni media consolidate. Ma in che misura questi attori affermati seguiranno la scia del denaro, spingendoli a costruire la propria presenza su piattaforme di aggregazione, social media e CTV, e accelerando il declino delle proprie piattaforme tradizionali? La propensione dei consumatori ad accettare contenuti supportati da pubblicità continuerà a crescere o potrebbe esserci una reazione negativa man mano che i finanziamenti ai brand diventano più sofisticati e la fiducia diminuisce? La capacità dei giganti della tecnologia di applicare l'intelligenza artificiale alla pubblicità su larga scala sarà la forza che li trasformerà nei principali fornitori di contenuti del futuro? La politicizzazione dei media sarà una forza chiave del mercato perché i media e l'intrattenimento digitalizzati sono oggi canali pervasivi e persuasivi come non lo sono mai statti in passato. Il modo in cui queste forze operano nei diversi paesi, con ecosistemi mediatici diversi, plasmerà di per sé i mercati locali e internazionali: in Cina e in USA con Trump lo fanno già da molti anni. Ciò che non si considera è se le forze dell'interferenza governativa, della regolamentazione, dell'opinione pubblica e i danni collaterali derivanti da tensioni politiche ed economiche più ampie possano essere così grandi da prevalere sulle altre forze di mercato. In regioni come l'Europa, come si rifletterà sui consumatori il taglio dei finanziamenti al servizio pubblico radiotelevisivo? Sarà accettato o respinto, dato che i concetti di fiducia e verità vengono politicizzati? Questo tentativo di definire cinque fattori noti non fa che enfatizzare l'incertezza del futuro dei media, ma c'è un filo conduttore, infatti ciò che consideriamo l'industria dei media e dell'intrattenimento sarà presto rimodellato. Qualsiasi entità che abbia un pubblico e denaro, ma non abbia debiti tecnologici o inerzia culturale, ha l'opportunità di diventare una forza significativa molto più rapidamente che in qualsiasi altro momento del passato. Non è tanto che ci siano barriere all'ingresso, quanto che gli operatori storici abbiano barriere alla resistenza: la trasformazione sarà più difficile della rottura.

Dal 2025 le aziende di streaming e di distribuzione CINEMA DIGITALE dovranno bilanciare redditività e performance, il che richiede non solo strategie di monetizzazione innovative, ma anche soluzioni di distribuzione solide. Mentre modelli come il video on demand in abbonamento (SVOD), il video on demand basato sulla pubblicità (AVOD) e la televisione in streaming gratuita con pubblicità (FAST) continuano a evolversi. La vera sfida consiste nell'incrementare gli abbonamenti e ridurre il tasso di abbandono perché gli spettatori richiedono uno streaming fluido e di alta qualità, e soddisfare queste aspettative favorisce la fidelizzazione dei clienti, contribuendo direttamente alla redditività. Offrire un'esperienza di qualità eccezionale e adottare soluzioni di distribuzione scalabili ed economiche è essenziale per fidelizzare gli spettatori e garantire una crescita a lungo termine, Netflix docet. AVOD e FAST continueranno a dominare, poiché le piattaforme di streaming cercano una monetizzazione sostenibile. La sfida principale nel 2025 sarà rendere questi modelli più convenienti.

Il 18 giugno avviremo questo tavolo di lavoro sullo sviluppo di un nuvoi media per la produzione culturale di vlaore per il network rotariano

https://www.facebook.com/p/Rotary-Club-Roma-Aniene-100067728096167/?locale=it_IT

SEGUTE #OTTMEDIA #OTTROTARY #OTTEUREBO #EUREBOMULTIMEDIA #EUREBOTV